ディープフェイク(Deep Fake)技術は、現実と虚構の境界を曖昧にし、新たな可能性を切り開く一方で、深刻な懸念事項も浮かび上がらせる技術です。

この記事では、ディープフェイクの基本から最新の応用、そして潜在的なリスクまでを探りました。ディープフェイクの未来は明るい一方で、我々はその波にどのように対処し、健全な社会を築くかについても考えなければなりません。

人は印象に左右される!?

人は物事を記憶する際に印象に大きく影響を受けます。ディープフェイクとはこの「印象」と「個人の記憶」に強く影響するものと言えるでしょう。

嘘の情報を事実と信じてしまうのもこのためであり、その代表例がマンデラ効果でしょう。

マンデラ効果とは?

「マンデラ効果」という言葉は、記憶の歪みと印象に強く影響を受けた誤った記憶に関連する心理現象のことをいいます。

マンデラ効果は、元南アフリカ大統領のネルソン・マンデラの死亡報道に由来しています。

マンデラ氏の没年は今や多くの人が知るところですが、ある時期までは1980年代に獄中死していると多くの人が信じていました。

しかし、実際にはマンデラ氏は投獄後も生存しており、1990年に釈放され釈放後に南アフリカの大統領に就任、最終的に2013年に亡くなっています。

これは多くの人々が、マンデラ氏が投獄後に死亡したのだと誤って記憶していたためであり、印象による記憶の歪みや、集団記憶の影響だとされています。

ディープフェイクとの関連はあるのか?

ディープフェイク技術は、画像や動画を合成し、事実ではない出来事を作り出す性能を持っています。マンデラ効果は、人々の記憶が歪んで間違った記憶をしてしまうことがあることを示唆していますが、ディープフェイクが生む問題はさらに複雑です。

なぜなら、ディープフェイクは画像という視覚的な証拠を世の中に提供し、集団的に誤った記憶を形成するのが容易であるからです。

マンデラ効果は、ディープフェイクの問題と無関係とは言えないでしょう。

ディープフェイクの正体は何なのか?

ディープフェイクについては以下のように述べられています。

引用: NEC

ディープフェイクの実態は画像AI技術によって生成されたメディアです。

ディープラーニング(深層学習)と呼ばれる機械学習技術の一分野を活用して作られたAIによって生成された画像や動画、または音声のことを指します。

この技術は、元の素材から特定の要素を学習して新しい画像や音声を合成、または新しく生成することができます。ディープフェイクは、主に顔や声を操作するために使用され、その結果、実在する人物が何かしらの行動や発言を行ったように見せかけることができます。

ディープフェイク技術は、2017年ごろから急に注目されるようになりました。

インスタグラムにアップロードされた、米フェイスブック(現Meta社)のマーク・ザッカーバーグ最高経営責任者(CEO)が秘密組織への感謝を述べて話題になった動画は有名です。

本物と見紛うほどリアルな動画が生成されており、技術的に詳しい人以外は見分けることが難しいのではないでしょうか。この背景には、Generative Adversarial Networks(GANs)と呼ばれる機械学習モデルの技術的な発展と普及に影響を受けています。

このようにAIは非常にリアルな偽の情報を作り出すことができるほど進化しています。

最新AIが作るリアルな画像

ディープフェイク技術を使うことで、画像、動画、音声など様々なメディア媒体のデータを生成することができます。ディープフェイク技術には、主に

- 画像ベース

- 動画ベース

の2つの種類が使用されます。

画像ベース

画像系の技術は、静止画像の生成に使われており、主に人物の顔を操作するのに使用されます。

例えば、有名な人物の顔を他の人物に置き換えたり、表情や口の動きを変更したりすることが可能です。

動画ベース

動画ベースのディープフェイクは、動画のワンシーンや会話を生成するのに使われています。

有名な映画キャラクターが新しいセリフを話したり、政治家が公の場で異なる発言をしたように見せたりすることができます。

これら2つの技術を同時に使って作られた、オバマ元アメリカ大統領の画像を別人の画像に被せて作られた偽の演説動画は有名ですね。

また嘘の画像を生成する竹ではなく、ディープフェイク技術は、様々な分野で利用されています。例えば、エンターテインメントの分野では、 映画やテレビ番組の特殊効果に使用され、キャラクター制作や映画のワンシーンの編集などに活用されています。

また、映画のリメイクにおいて過去の俳優を現代に蘇らせるためにも使用されます。

さらに、静止画から立体的なキャラクターを生み出し、さらに高度なディープフェイクを実現します。このように、最新のAI技術を用いることで、3Dキャラクターを生成することができます。

制作された映像では、生成画像をキャラクターの口の動きを正確に合わせて動かすことなどもできます。このようにリップシンクを向上させて、現実の人間のリアルな動きを動物のキャラクターにさせることなどもできます。

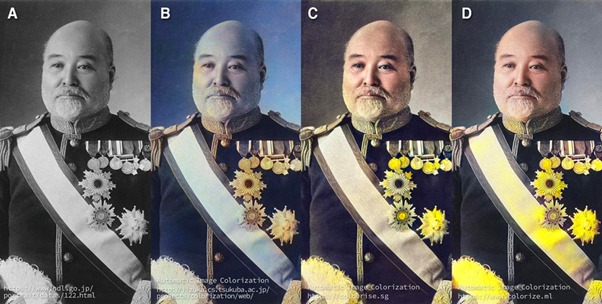

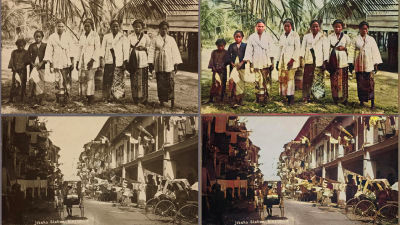

さらに、白黒画像をカラー画像にしたり、ぼやけた写真や古い写真、ビデオフレームを驚くほど鮮明にし、細部まで再現することが可能になりました。

最新のAIは低解像度の写真を高解像度にアップスケーリングすることができます。

出典:アジャストフォトサービス

最新ディープフェイクアプリの紹介

最近では、最新の生成AI技術を活用したアプリケーションも多数登場しています。

いくつかの例をご紹介します。

DeepFaceLab

出典:deepfacelab

DeepFaceLabは、ディープフェイクの生成に広く使用される人気のあるツールの1つです。

2つの異なる顔を交換することができる機能(フェイススワップ)を実装することができます。

俳優の顔を映画キャラクターに差し替えたり、歴史的な人物の顔を現代の人物に置き換えたりすることが可能です。他にもリップシンクや動画のフレーム補完などができます。

ColouriseSG

出典:ColouriseSG

ColouriseSGはモノクロ写真に色づけしてカラー写真に変換するために、ディープラーニングの技術を活用して作成されたツールです。

開発には、シンガポールの政府関係技術者が携わっています。

Xpression

Xpressionはスマートフォン用のアプリです。

あらゆる人や動物などの顔の映像や写真を自由に動かしたり、しゃべらせたりすることができます。

Reface

こちらも、 顔画像の交換アプリです。スマートフォン(iOS)で使用することができます。

Avatarify

AvatarifyはAI Face Animatorアプリです。自分が撮影した写真など、人物や顔が映っている自分好みの画像をアップロードすると「画像がしゃべっているかのように見える動画」を自動で制作してくれるディープフェイクアプリです。

TikTokなどでよくショート動画を見かけることがあります。

ディープフェイクアプリはディープラーニングの技術を使い、写真に写った人物や動物などに動きや音声、音楽を加えて本当に動いてしゃべっているように加工できるアプリが主流です。

今後は様々なメディア形式でデータを生成して楽しむことができるかもしれません。

フェイク画像を生成する仕組み

ディープフェイクは、生成AIにより生成された、画像や映像データです。

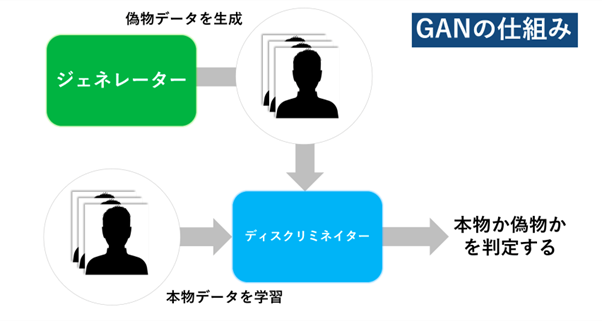

そのため、主にGANs(Generative Adversarial Networks:敵対的生成ネットワーク)という技術が用いられます。

GANsは、偽画像を生成する役割を持つ生成モデルと偽画像か本物の画像なのかを判定する識別モデルが互いに競い合うことで、非常にリアルなデータを生成する能力を持っています。

例えるなら、偽札の製造者(生成モデル)が作った偽札(ディープフェイク画像)を、警察(識別モデル)が本物の紙幣か偽札かを判別します。

偽札と見抜かれると、偽札の製造者はより本物に近い精巧な偽札を作り、それをまた警察が識別します。

このイタチごっこを繰り返すことにより、最終的には警官が「本物」と誤認してしまうほどの、限りなく本物に近い偽札(ディープフェイク画像)が完成します。

ディープフェイクの核心的なアイデアは、このGANsを用いて、元のデータ(例えば本物の顔写真)から生成モデルを学習し、それを使用して合成データ(ディープフェイク)を生成することです。GANsはまさにディープフェイクの鍵となる技術です。

出典:spectee

ディープフェイクの悪用問題

ディープフェイクは社会に与えるインパクトが大きく、使い方によっては大変な脅威になります。技術的な進化によって、情報の真偽を判断することが一層難しくなるという大きな問題を引き起こしています。特に以下の点が懸念されている事項です。

- フェイクニュースの拡散

- プライバシーの侵害

- 信頼性の低下

ディープフェイクによって作成された映像や音声が、事実であるかのように拡散され、誤ったニュースが広がりやすくなっています。また、個人の顔や音声を無断で使用して、偽の映像や音声を制作しネットに晒すことで、その人物のプライバシー侵害のリスクがあります。

さらに、高品質のフェイクニュースが作成できる技術が民主化され、広く認知されると、情報源の信頼性が低下する恐れもあります。

ここで、どのような悪用の事例があるのかご紹介します。

有名人や政治家へのなりすまし

ディープフェイクの悪用でまず懸念されるのが、有名人や政治家へのなりすましです。

ディープフェイクは政治家の演説やインタビューを操作し、異なる文脈で使用することがあり、政治的な混乱や偽の情報を広める要因となります。

前述のバラク・オバマ氏の事件では、2018年の中間選挙の数ヶ月前に、オバマ氏が当時のアメリカ大統領ドナルド・トランプ氏を非難する動画が流行しました。

しかし、これはプロデューサー・監督であるジョーダン・ピールが、オバマ氏の声を真似し、動画の唇の動きをピールの言葉とシンクロさせたディープフェイク動画でした。

これは、ピールがウェブ上で遭遇した素材を信用することへの警告として制作したものでした。

また、2022年3月16日にFacebookとYouTube上に、何者かによって、ウクライナのウォロディミル・ゼレンスキー大統領の動画が投稿されました。

この動画は、ゼレンスキー大統領がウクライナ軍に武器を置くように呼びかけ、ロシアへの降伏を発表しているかのように見せかけていますが、ディープフェイク動画でした。

一国の大統領の一言は政治的に大きな意味を持つため、フェイクニュースが出回ることで国際的に大きな問題となりかねません。

参考:sedesign

フェイクポルノ

ヘイクポルノもディープフェイク動画の悪用事例として問題となっていることの1つです。

現状で最も悪用の多いケースは、ポルノ動画に登場する俳優の顔部分だけを別の有名人の顔と差し替えるフェイクポルノです。

2019年に実施されたオランダのセキュリティ企業「DeepTrace」の調査によると、7か月間で約1万4678件のディープフェイク動画が確認され、その96%がポルノ動画であったと報告されています。

また、2019年6月には約4万9000件のディープフェイクが確認され、その大半がポルノ動画であったと報告されています。このような、有名人の顔を使用したディープフェイクポルノ動画が国内外問わず多数制作・拡散されています。

ディープフェイクポルノ動画の制作や拡散に関与すると、名誉毀損罪や著作権法違反、わいせつ物頒布等罪などの罪に問われる可能性があります。

実際に2020年10月、アダルトビデオ出演者の顔を女性芸能人と差し替えた容疑で、名誉毀損と著作権法違反の疑いで逮捕者がでています。

また隣国の韓国でも、芸能人100人余りのディープフェイク技術を使ったわいせつ画像3000件余りが製作、および配布されているという告発を受け、韓国警察が捜査に乗り出す事態に発展しています。

参考:MIZUHO、chosunonline

サイバー詐欺

ディープフェイクは、仮想通貨やビジネスにおける標的型攻撃、ビジネスメール詐欺(Business Email Compromise、BEC)など、あらゆるタイプのサイバー詐欺に使用されるおそれがあります。

フェイクニュースのように取引相手になりすまし、詐欺にの手口に引き込まれることもあり、十分な注意と情報収集が必要です。

参考:xtech

まとめ

ディープフェイク技術は、AIの進化に伴い驚異的な発展を遂げ、私たちのデジタル世界に大きな影響を与えています。この記事では、ディープフェイクが印象や信頼性に与える影響から、その基本的な仕組みまでを詳しく探ってきました。

ディープフェイクの印象への影響は、現代社会においてますます重要となっています。

人々はディープフェイクによって錯覚を引き起こされ、虚偽の情報に惑わされることがある一方、創造的な表現やエンターテインメント分野で新たな可能性も広がっています。

ディープフェイク技術の基本的な仕組みは、データ収集、顔検出、ニューラルネットワークの構築、GAN(Generative Adversarial Networks)の訓練といったステップから成り立っています。

GANは、生成器と識別器という2つの要素が互いに競争し合うことで、ディープフェイクの品質向上が実現されます。

ディープフェイクは悪用される可能性もあり、偽情報の拡散やプライバシーの侵害などの懸念事項も存在します。そのため、倫理的なガイドラインと法的な枠組みが不可欠です。

一方で、ディープフェイク技術はクリエイティビティやエンターテインメントにも革命をもたらしており、映画制作やビデオゲームの分野で新たな表現の幅を広げています。

最終的には、私たちがディープフェイクを受け入れ、その潜在的なリスクを管理するために技術と倫理の両面で努力する必要があります。

ディープフェイク技術の発展は、我々のデジタル未来を大きく変えつつあり、その影響を正しく理解して活用する必要があります。